Le code ouvert et la licence libre ne font pas tout. À la fin ce qui compte, c'est le plébiscite de la plateforme par les développeurs

Ça se dit, ça se répète, NVIDIA est le fabricant dont tous choisissent les cartes graphiques (GPU) pour effectuer les calculs massivement parallèles indispensables à l'IA. Par exemple pour l'inférence (faire converser un "modèle de langage large"), pour la diffusion stable (générer des images commandées par prompteur), ou plus généralement pour l'apprentissage profond auquel sont exposés les réseaux de neurones. Dans une

diatribe restée célèbre (en) il y a plus de 10 ans, Linus Torvalds critiquait acerbement NVIDIA pour son hostilité au logiciel libre. Bien que depuis 2022 NVIDIA ait partiellement

ouvert ses pilotes logiciels, le fabricant continue d'interdire l'usage du code de ses bibliothèques CUDA (l'API dédiée au calcul parallèle sur les GPU NVIDIA) sur d'autres produits que les siens, et maintient bien sûr fermés et propriétaires les firmwares de ses produits. Et le succès commercial est du coté de NVIDIA.

Depuis son

rachat d'ATI en 2006, AMD est l'un des deux autres fabricants américains de GPU (le troisième est depuis peu

Intel lui-même). AMD est privilégié sur Linux, depuis son adoption de l'open source et des licences libres pour ses cartes graphiques. Ses pilotes logiciels et ses bibliothèques ROCm (l'API dédiée au calcul parallèle sur les GPU AMD) sont open source, seuls ses firmwares restent propriétaires. Pour les calculs massivement parallèles en usage professionnel (CAO, calcul scientifique), les GPUs AMD ont une notoriété. Et depuis 2024, Ollama, l'application gestionnaire qui rend si facile l'installation et l'exécution de centaines de variantes des grands modèles LLM open source,

prend en charge l'API ROCm (en) d'AMD, après avoir commencé à fonctionner exclusivement avec l'API CUDA de NVIDIA. Alors, bravo AMD et sa priorité au logiciel libre ?

Et bien pas vraiment.

Parce que la notoriété d'AMD pour les applications en Intelligence Artificielle ressemble à celle d'une casserole attachée à la queue d'un chat. Le web bruisse de propos peu flatteurs:

documentation défaillante (en),

peu de modèles de cartes graphiques compatibles (en), équipe de développement sous-dimensionnée

en comparaison des bugs à corriger (en)... En un mot, quand on veut faire fonctionner des modèles d'intelligence artificielle, l'environnement logiciel mis à disposition d'AMD est au mieux en version beta. Le fait qu'il soit open source et libre n'attire pas par magie les contributeurs et ne remplace pas l'investissement encore nécessaire de la part du fabricant.

Car adopter des licences libres pour le logiciel n'immunise pas contre le cruel effet d'

externalité de réseau: lorsque la qualité n'est pas là, les utilisateurs sont rares, les contributeurs encore plus, et "la mayonnaise ne prend pas"; lorsque au contraire, une autre proposition technique concurrente est plus mature, même non libre, elle commence à être plébiscitée, son adoption s'en trouve amplifiée. NVIDIA champion du logiciel propriétaire tire aujourd'hui bénéfice de son avance en qualité sur l'API CUDA, tandis qu'AMD champion du logiciel libre, peine à convaincre d'utiliser son API ROCm.

La qualité n'est pas une condition moindre du succès que la liberté du code ouvert.

Lire la suite de Intelligence Artificielle sur CUDA ou ROCm ?

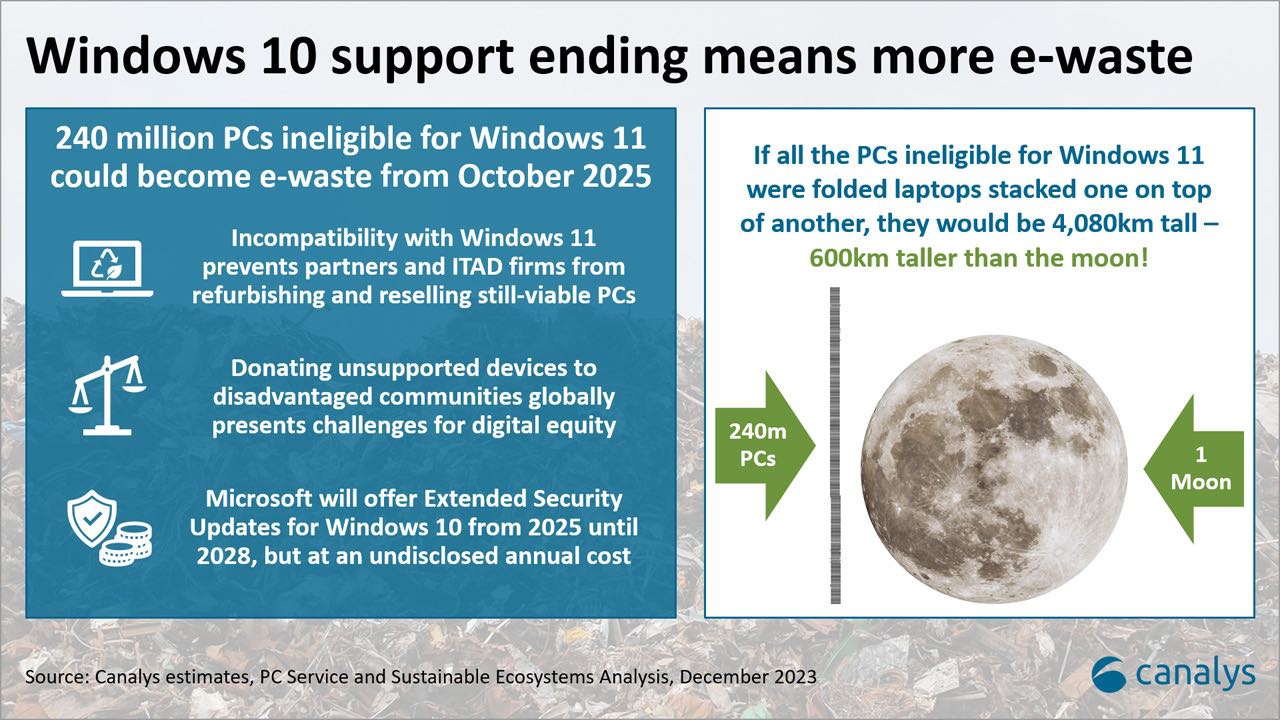

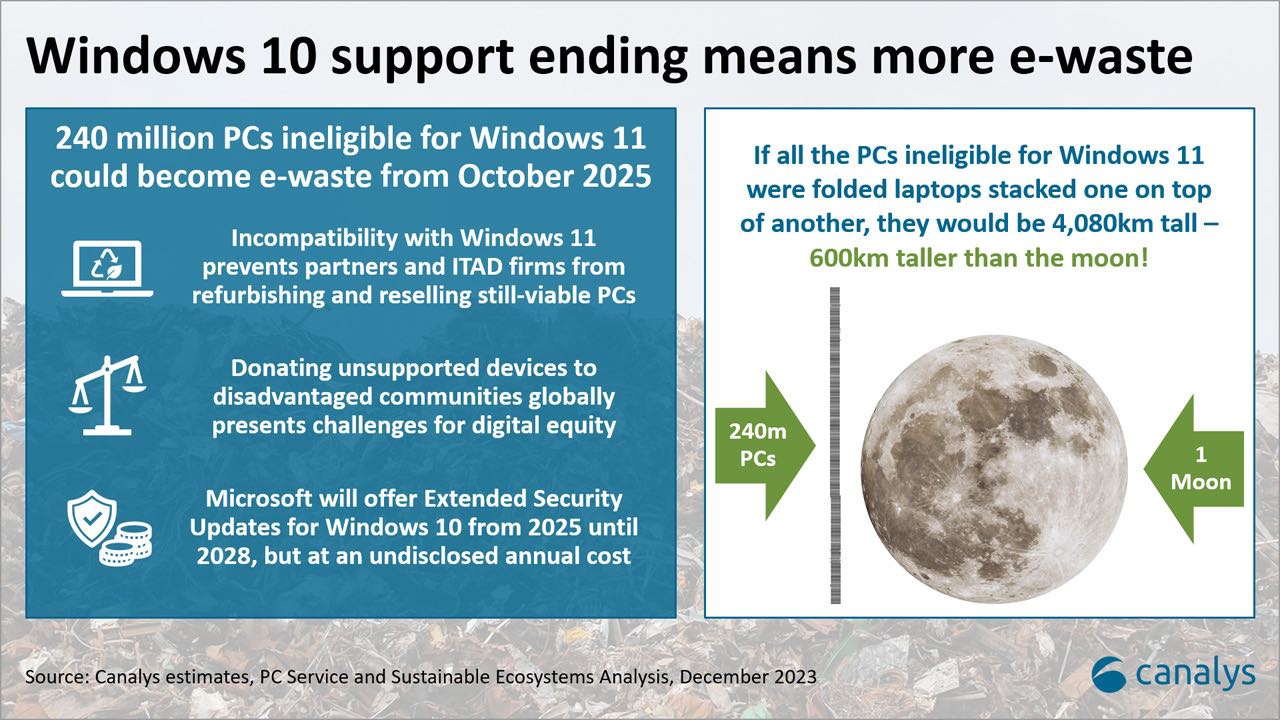

La fin du support pour Windows 10 signifie plus de rebuts informatiques

Quand le support de Windows 10 va progressivement s'éteindre à partir d'octobre prochain,

environ 240 millions de PC ne parviendront pas à satisfaire les pré-requis de Microsoft (en)

pour accueillir Windows 11. C'est en soi une bonne chose, Windows 11

étant un OS menteur et spoliateur à un point encore jamais atteint

auparavant. L'absence sur la carte mère d'un module de sécurité et de

confiance (

TPM - Trusted Platform Module) dans sa version 2.0 définie en 2014, est la cause de cette incompatibilité artificielle.

Mais

ça aura une conséquence écologique: les canaux de distribution

marchands sont habitués à recycler les PC d'occasion, à condition d'y

installer Windows; par contre, ces mêmes canaux n'envisagent pas de

s'occuper des PC pour lesquels Windows est devenu indisponible. Ça sort

de leurs procédures de "refurbishing" et du marketing prévu pour une clientèle peu habituée aux systèmes d'exploitation libres.

Bien que fonctionnels, ces pauvres ordinateurs auront alors perdu toute valeur marchande. Si tous étaient des laptops,

Wall-E pourrait en faire progressivement une pile de 4000 km de haut.

Progressivement, parce que l'abandon de ces machines se fera sur

plusieurs années, certains à la marge se contorsionneront pour continuer

à utiliser Windows 10 au-delà de sa date de péremption.

Lire la suite de Vieux PC: l'industrie du recyclage n'en veut pas sans Windows

Bonjour la communauté des E2lisiens

Vous avez peut-être remarqué que je me fais rare en début de cette nouvelle

année ; c’est parce que j’ai eu un petit accident de bicyclette.

Cela tombe bien que je vous parle de cela, je voudrais soumettre à commentaire

une idée.

Lors de mon accident, j’ai été pris en charge par les

pompiers qui m’ont posé des questions pour évaluer mon état et aussi des

questions administratives du type : nom, adresse, personne à contacter… .

Puis les policiers sont arrivés et m’ont posé des questions sur la survenue de

l’accident et m’ont posé des questions administratives du type : nom,

adresse, personne à contacter… . Les pompiers m’ont amené à l’hôpital où là les secrétaires médicales de l'accueil ont directement commencé à me poser des questions administratives du type :

nom, adresse, personne à contacter… .

J’étais suffisamment conscient pour répondre à toutes ces

questions, mais leur réponse a eu un impact temporel non négligeable sur

l’activité à la fois des pompiers, des policiers et du secrétariat médical des urgences.

Le surlendemain de mon accident, je suis allé à la caserne

de pompier pour obtenir des documents et j’en ai profité pour leur demander ce

qu’ils pensaient de l’idée que je vais vous soumettre. Les deux personnes ont

eu l’air convaincues de l’utilité et m’ont conseillé de la soumettre au siège

du SDIS (service départemental d’incendie et de secours).

Je vous propose de créer une (ou plusieurs) carte par personne à porter comme

une carte de groupe sanguin, mais qui contienne(nt) les informations chiffrées

que l’utilisateur aura bien voulu renseigné pour permettre une saisie

rapide et fiable des informations dont les secours au sens large ont besoin.

Lire la suite de Carte d'Informations Personnelles (CIP)

Cette question revient périodiquement, de la part de nouveaux

adhérents ou de personnes qui viennent nous rendre visite dans notre

salle ou sur les stands que nous tenons, lors d’évènements

publics comme Ivry en Fête ou la Fête du Libre. Ils

s’étonnent que nous n’utilisions pas ces outils « pratiques

et conviviaux », comme ils le disent, avec lesquels ils se sont

habitués facilement et les utilisent dans tous leurs échanges :

professionnels, associatifs et familiaux.

Et donc pour

répondre à cette question nous allons consulter la listes des

principaux réseaux sociaux (*1) et les passer en revue en expliquant

pour chacun d’eux ce qui nous pose problème.

Lire la suite de Pourquoi l’E2L est absent des réseaux sociaux ?

Rust est un langage de programmation développé par Mozilla qui se

concentre sur la sécurité et la concurrence. Il est développé

conjointement par un des leaders du langage web, Brendan Eich

(inventeur de JavaScript en 1995), Dave Herman, et Graydon Hoare de

Mozilla.

Rust

est un excellent langage pour la sécurité, la concurrence avec

l'utilisation automatique des systèmes multicœurs et comporte des

caractéristiques importantes, comme d'autres langages dynamiques,

telles que :

gestion automatique de la mémoire,

suppression des pointeurs nuls,

sécurité du code, etc.

Rust

est un logiciel libre et gratuit qui est mis à la disposition de

tous et partagé publiquement afin que les utilisateurs puissent

améliorer le langage et la conception du logiciel.

Et

depuis 2020, il y a le projet Rust for Linux !

Lire la suite de Pourquoi programmer en Rust ?